Es probable que nunca lo hayas escuchado y nunca te hayas preguntado ¿Que es la computación neuromórfica? En este articulo te vamos intentar aclarar un poco.

Introducción ¿Que es la computación neuromórfica?

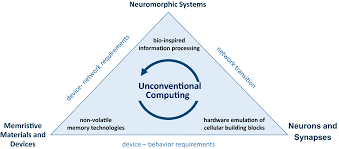

La computación neuromórfica es un método de ingeniería informática en el que los elementos de un ordenador se modelan a partir de sistemas del cerebro y el sistema nervioso humanos para intentar emular la forma de procesamiento del cerebro humano.

Los semiconductores son a menudo llamados los cerebros de la electrónica. Con el tiempo, la potencia de estos diminutos chips de silicio ha crecido exponencialmente, incluso cuando sus circuitos se han reducido a tamaños inimaginables. De hecho, siempre hemos podido contar con que las mejoras de los procesadores reflejen las del hardware y el software.

Pero con vehículos autónomos, robots, drones y otras máquinas autosuficientes que requieren chips pequeños pero potentes y eficientes energéticamente, y con los semiconductores tradicionales alcanzando los límites de la miniaturización y la capacidad, los investigadores afirman que es necesario un nuevo enfoque del diseño de semiconductores.

Una pequeña historia de la computación neuromórfica

La ingeniería neuromórfica no es una disciplina nueva. Se puede decir que es relativamente desconocida fuera de los círculos académicos y de investigación, pero en realidad existe desde hace más de 30 años, cuando a finales de la década de 1960 se le ocurrió, Carver Mead, un ingeniero eléctrico estadounidense formado en el prestigioso Instituto de Tecnología de California (Caltech), la idea de diseñar circuitos integrados y algoritmos que imitaran el comportamiento del sistema nervioso animal.

El cerebro, el órgano más complejo de nuestro cuerpo, procesa la información con extrema eficacia, y Mead intuyó que los ordenadores podrían inspirarse algún día en él para alcanzar capacidades que los algoritmos computacionales clásicos nunca podrían igualar.

Su visión empezó a materializarse en los laboratorios a finales de los 80, dos décadas después de su intuición inicial, y en la última década y media, muchos grupos de investigación y empresas han lanzado proyectos, convirtiendo la ingeniería neuromórfica en una disciplina con un potencial abrumador. Quizá incluso revolucionaria.

Una alternativa prometedora ya está generando un gran interés: la computación neuromórfica.

Gartner predice que las tecnologías informáticas tradicionales basadas en la arquitectura de semiconductores heredada chocarán con un muro digital en 2025 y forzarán el cambio a nuevos paradigmas, incluida la computación neuromórfica. Emergen Research, por su parte, afirma que el mercado mundial de procesamiento neuromórfico alcanzará los 11.290 millones de dólares en 2027.

La ingeniería neuromórfica no va a sustituir al hardware de propósito general, pero podría ser enormemente importante para resolver retos tecnológicos especiales o específicos, como la implementación eficaz de la inteligencia artificial en el borde, para la cual La investigación está avanzando rápidamente.

Una tecnología que intenta imitar a la biología

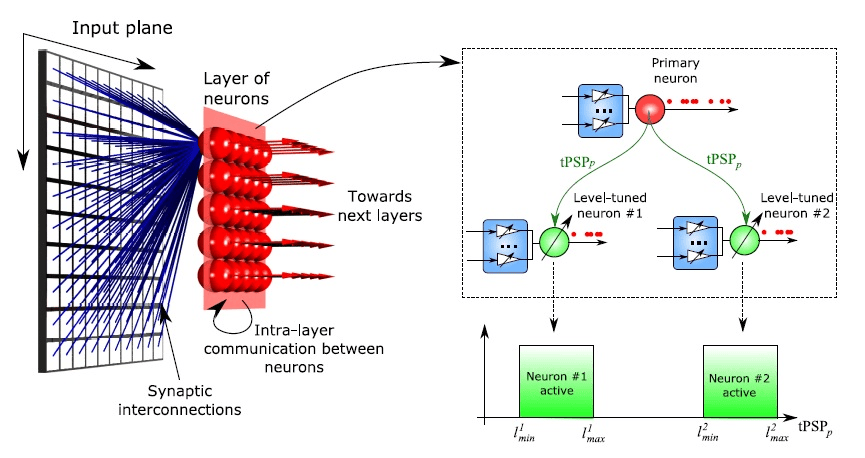

La computación neuromórfica funciona imitando la física del cerebro y el sistema nervioso humanos mediante el establecimiento de lo que se conoce como redes neuronales con picos, en las que los picos de las neuronas electrónicas individuales activan otras neuronas en una cadena en cascada. Es análogo al modo en que el cerebro envía y recibe señales de las neuronas biológicas que desencadenan o reconocen el movimiento y las sensaciones de nuestro cuerpo.

A diferencia de los enfoques más tradicionales, en los que los sistemas orquestan la computación en términos binarios rígidos (¿Es un 1 o un 0? ¿Un sí o un no?), los chips neuromórficos computan de forma más flexible y amplia.

Sus neuronas en espiga funcionan sin ningún orden prescrito.

La idea es conseguir que los dispositivos informáticos lleguen al punto de poder pensar de forma creativa, reconocer personas u objetos que nunca han visto y ajustarse de algún modo para actuar. La mayoría de los investigadores admiten que aún no lo han conseguido. Por ejemplo, si se entrena a un ordenador tradicional cargado de programación de IA para que juegue al clásico juego de Atari “Breakout”, en el que los jugadores utilizan una paleta digital y una pelota para atravesar una capa de ladrillos, probablemente siempre derrotaría a los humanos.

Pero si se le diera a la IA una nueva paleta que fuera 10 píxeles más alta o más baja, lo más probable es que se confundiera y se rompiera. Los humanos probablemente empezarían a ganar porque, a diferencia de las IA, nuestros cerebros son extraordinariamente hábiles para entender la causa y el efecto.

Conseguir que la tecnología supere ese obstáculo no será fácil. Pero algunas empresas tecnológicas como Intel,IBM, Airbus SE, Accenture y HP entre otras, así como diversos centros de investigación y académicos a lo largo de todo el mundo, lo están explorando. Y los avances de los últimos años sugieren que están haciendo progresos considerables.

El año pasado en 2021, por ejemplo, Intel mostró un robot neuromórfico que puede ver, reconocer y hasta oler a objetos desconocidos basándose en un solo ejemplo, que a diferencia de los modelos tradicionales que requieren muchas instrucciones y datos.

Del mismo modo, Intel y la Universidad de Cornell presentaron algoritmos matemáticos, utilizados en el chip de texto neuromórfico de Intel, Loihi, que reproducen fielmente cómo el cerebro “huele” algo.

Los investigadores de Intel afirman que Loihi reconoció rápidamente 10 olores diferentes, una capacidad que podría aplicarse a la seguridad de los aeropuertos, la detección de humo y monóxido de carbono y el control de calidad en las fábricas.

Por otro lado, en los laboratorios de Accenture, otros cientistas hicieran una demostración de “Automotive Voice Command”, un experimento basado en el chip de Intel, Loihi, para aportar capacidades de comando de voz, gestos e inteligencia contextual a los vehículos sin agotar las baterías.

Por ejemplo, el sistema podría reconocer órdenes de voz, como “Arrancar mi motor”, y hacerlo 200 milisegundos más rápido y consumiendo 1.000 veces menos energía que una GPU estándar. Otros investigadores también han enseñado recientemente al mismo chip a reconocer gestos de una mano sobre la marcha utilizando como base una regla de plasticidad sináptica inspirada en el funcionamiento del cerebro.

En el camino hacia la competencia

Este aprendizaje se produce mucho más rápido que con los ordenadores tradicionales, de nuevo por la forma en que la computación neuromórfica emula la biología. En nuestros cuerpos, el cerebro realiza cálculos con información que está físicamente cerca. Pero en los ordenadores tradicionales hay una separación entre el procesamiento (en la CPU) y la memoria (en la RAM). La computación depende del movimiento de datos entre esas ubicaciones, lo que crea un cuello de botella que ralentiza la velocidad de cálculo, aumenta los costes de computación y quema enormes cantidades de energía, especialmente cuando se trata de tareas complejas.

En la computación neuromórfica, sin embargo, todo el cálculo puede realizarse de forma analógica o en la memoria. Si se realiza en la memoria (que es la dirección que está tomando la tecnología), la latencia queda prácticamente eliminada, y el consumo de energía se reduce drásticamente hasta el punto de que un dispositivo podría funcionar con una pequeña batería durante años en lugar de meses o semanas.

Esto abre un mundo de posibilidades para incluir los chips en máquinas que necesitan realizar localmente operaciones de aprendizaje profundo computacionalmente complejas, como los vehículos autónomos, los drones militares y los ordenadores de alto rendimiento, o en dispositivos de bajo consumo simplificados que solo necesitan funcionar de forma fiable durante largos periodos de tiempo, como las cámaras de seguridad de oficinas o tiendas.

Aceleración del desarrollo global

Como concepto, la computación neuromórfica existe desde la década de 1980. Pero ha cobrado fuerza en los últimos años debido al creciente interés en áreas tecnológicas específicas, como la IA, el aprendizaje automático, los sensores, el análisis predictivo, la transmisión de datos en tiempo real y el modelado, que podrían prosperar significativamente con más potencia de procesamiento y eficiencia. El aumento de la inversión por parte de las industrias de la automoción, aeroespacial y de defensa que desean aplicar la innovación de la Industria 4.0 también está impulsando el progreso.

Sin embargo, curiosamente, gran parte de esta actividad se está produciendo fuera de Estados Unidos. China, por ejemplo, parece estar gastando mucho más que Estados Unidos, según los investigadores.

Recientemente, algunas universidades Australianas han creado un sistema que denominaron como “el procesador neuromórfico óptico más rápido y potente del mundo” para la IA., fue fruto de la colaboración entre investigadores de varias universidades de Australia, Canadá, Hong Kong y China.

Este chip está construido, sobre lo que se llama microcombos ópticos, son capaces de realizar 10 billones de operaciones por segundo, lo que supone una velocidad 1.000 veces superior a la de los procesadores anteriores. La tecnología podría revolucionar la forma de realizar los cálculos en los sistemas informáticos.

Esta tecnología de los microcombos tiene unas implicaciones impresionantes que permitirían tener al alcance la construcción de dispositivos comerciales con precisiones de calculo hiper precisas, y que permitirían su aplicación en sistemas de GPS, escuchar el universo, etc…

También se ha centrado en la tecnología de redes neuronales ópticas que podría mejorar drásticamente la exactitud y la precisión de las cámaras digitales integradas en maquinaria de funcionamiento autónomo, como los coches que se conducen solos, que nunca tendrán éxito si no reconocen los objetos a tiempo para detenerse. A medida que las capacidades monomórficas sigan mejorando la capacidad de la IA para reconocer comportamientos y patrones, la tecnología óptica también podría resultar útil para la investigación del cáncer de alto nivel o de nuevas enfermedades.

Posibles aplicaciones y ejemplos de la computación neuromórfica.

Los chips neuromórficos más avanzados que los científicos han desarrollado hasta ahora contienen decenas de miles de neuronas artificiales, diminutos elementos electrónicos que pueden comunicarse entre sí de forma muy similar a las neuronas de nuestro cerebro, para imitar su capacidad de procesar información. Esta estrategia significa que la arquitectura de estos chips es radicalmente diferente a la de los microprocesadores utilizados en los ordenadores, teléfonos móviles y tabletas, y es esta diferencia la que permite resolver problemas complejos de forma muy diferente a como los resolvemos con los ordenadores y los algoritmos clásicos.

El verdadero potencial de los sistemas neuromórficos reside en su capacidad para resolver determinados problemas de forma mucho más rápida y eficiente energéticamente que un ordenador convencional. Incluso para un superordenador. Esto es posible precisamente porque pueden imitar la forma en que nuestro cerebro maneja los problemas. Una de las características más importantes de los sistemas neuromórficos es su paralelismo inherente, que consiste en la capacidad de dividir un problema en otros más pequeños que pueden ser procesados simultáneamente por diferentes unidades funcionales del sistema neuromórfico.

Todo esto suena muy bien sobre el papel, pero para entender el verdadero potencial de la tecnología neuromórfica, necesitamos saber hasta qué punto un sistema neuromórfico puede superar a un ordenador convencional cuando ambos se enfrentan al mismo problema. Los sistemas neuromórficos actuales se utilizan principalmente con fines de investigación, y si observamos lo mucho que han evolucionado en la última década y media, parece razonable suponer que seguirán evolucionando significativamente a medio plazo, probablemente más allá del entorno académico y de los laboratorios de investigación.

En cualquier caso, las cifras de los sistemas neuromórficos actuales son bastante impresionantes. Pueden resolver algunos problemas hasta 1000 veces más rápido que un microprocesador clásico. Y son hasta 10 000 veces más eficientes energéticamente.

Estas cifras son muy impresionantes, pero es importante tener en cuenta que la computación neuromórfica no es la solución ideal para todos los problemas. Los investigadores buscan soluciones para cargas de trabajo complejas y altamente paralelas que requieren un enorme esfuerzo computacional y gasto de energía cuando se utiliza un ordenador convencional. En estas circunstancias, los sistemas neuromórficos pueden ser mucho más rápidos y eficientes que los actuales superordenadores con arquitecturas clásicas, pero no los sustituirán porque, como acabamos de ver, no sirven para resolver todos los problemas. Ambas arquitecturas coexistirán en el futuro.

Una de las disciplinas en las que la computación neuromórfica está teniendo un impacto significativo es la inteligencia artificial. Los investigadores están diseñando algoritmos capaces de procesar grandes cantidades de datos ruidosos y desestructurados en tiempo real, algo que los microprocesadores y algoritmos tradicionales no pueden hacer. Estos últimos son muy eficientes cuando se trata de resolver operaciones matemáticas muy complejas con las que nuestros cerebros y los sistemas neuromórficos que inspiran no se sienten cómodos, pero cuando se trata de probar la viabilidad de un gran número de soluciones en paralelo en un entorno cambiante a gran velocidad, la computación neuromórfica marca la diferencia. He aquí algunos escenarios en los que esta disciplina encaja como un guante:

- Problemas de optimización: un algoritmo neuromórfico puede ser de gran ayuda para encontrar la mejor solución a un problema determinado en tiempo real y de forma sostenida. Puede utilizarse, por ejemplo, para optimizar la velocidad de transmisión de un canal de comunicación adaptándose a condiciones difíciles de predecir en el tiempo.

- Aprendizaje automático: esta rama de la inteligencia artificial puede beneficiarse enormemente de esta disciplina, gracias al potencial para diseñar algoritmos neuromórficos que pueden entrenarse en un conjunto de datos finito para inferir nuevos conocimientos a partir de un conjunto de datos potencialmente infinito. Esta tecnología puede utilizarse en motores de búsqueda, programas de reconocimiento de voz, previsiones económicas, diagnósticos médicos, etc.

- Reconocimiento de patrones: los algoritmos neuromórficos están demostrando ser muy eficaces en procesos en los que es necesario identificar un conjunto de objetos heterogéneos en función de su similitud con uno o varios modelos de referencia. Por ejemplo, pueden utilizarse para reconocer rostros en una base de datos policial o para encontrar el camino más corto entre dos puntos conectados por varias rutas en una aplicación de navegación y cartografía.

- Satisfacción de restricciones: los algoritmos neuromórficos pueden diseñarse para que sean capaces de explorar un amplio conjunto de soluciones a un problema dado para encontrar las que satisfagan determinadas restricciones. Esta función es muy útil para encontrar la ruta óptima que debe seguir un repartidor de paquetes, para planificar la programación de las clases en un centro educativo, para diseñar estrategias que maximicen la probabilidad de ganar en un juego de mesa, etc.